双塔模型

[[DSSM]]

user

离线建图 + [[Approximate Nearest Neighbor Search]]

- 离线计算 item 的 embedding

[[@双塔模型最后一层为什么都进行L2 Norm? ;/]]

双塔训练方法 #card #depth-1

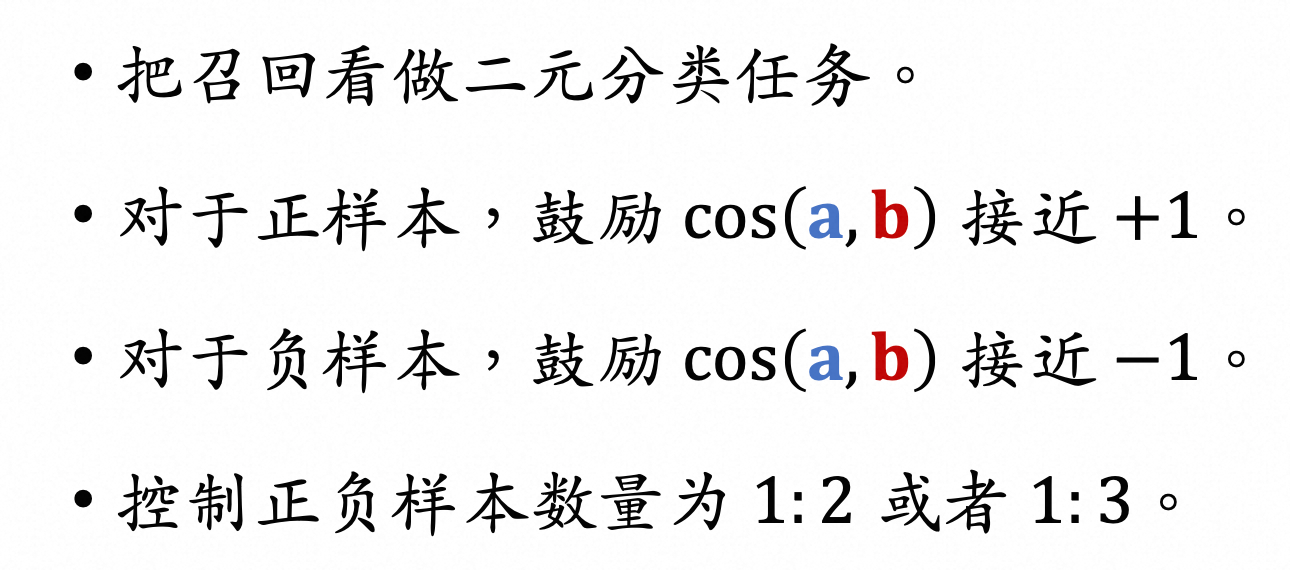

Pointwise:独立看待每个正样本、负样本,做简单的 二元分类 #card

[[Pairwise 训练]] 每次取一个正样本、一个负样本

[[Listwise 训练]] 每次取一个正样本、多个负样本

限制双塔能力的瓶颈在于 :-> 底层用户或物料特征在沿塔向上传递的过程中,一些细粒度的信息损失了,失去了与对侧信息交叉的机会。

技术改进方向:如何在每个塔最终输出的向量中保留更多的信息,从而有机会和对侧塔得到的向量交叉。

[[@SENet双塔模型:在推荐领域召回粗排的应用及其它]]

[[@深度粗排在天猫新品中的实践]] 双塔+FM

[[Attention Fusion]]

Ref