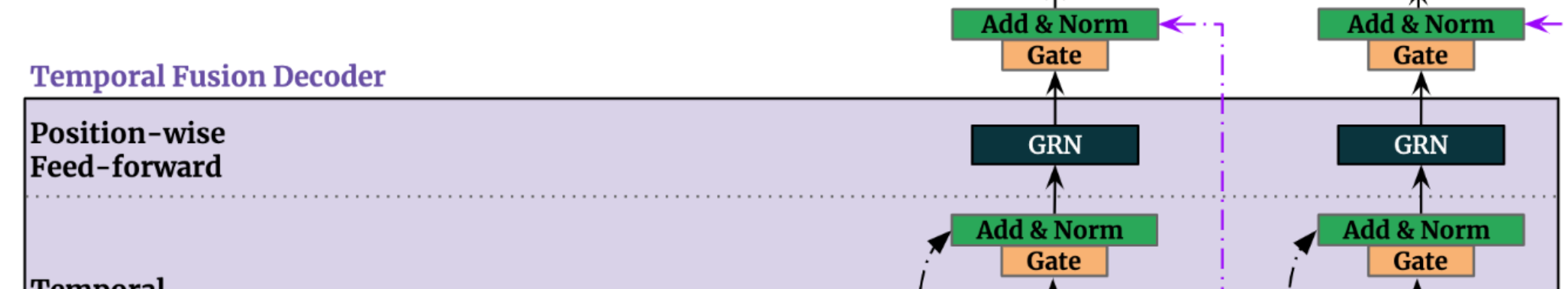

Temporal Fusion Decoder

((6430176a-f191-46f2-81a6-4c66716b2012))

((64301e4e-058b-48ad-9b4f-fca33d33ece1)) 在 TFD 前用 [[Seq2Seq]] 对数据进行一次增强 #card

- 重要的点通常是与周围的值相关系来确定的,例如异常值、变化点或周期模式 ((64301e96-44da-4b35-9af9-5de1a4da8315))

- 注意力机制架构中构建利用 point-wise values 的特征可以实现性能提升

- [[@Enhancing the Locality and Breaking the Memory Bottleneck of Transformer on Time Series Forecasting]] ((6430200f-c4ae-4707-93e0-320d05d3413e))

- LSTM encoder-decoder

- encoder 输入 $\tilde{\boldsymbol{\xi}}_{t-k: t}$ 前 k 步特征

- decoder 输入 $\tilde{\boldsymbol{\xi}}{t+1: t+\tau{\max }}$ 未来 tao 步特征

- 由 encoder 和 decoder 生成的时序特征可表示为 $\phi(t, n) \in\left{\boldsymbol{\phi}(t,-k), \ldots, \boldsymbol{\phi}\left(t, \tau_{\max }\right)\right}$

- 其中 n 为位置索引

- 时序特征输入到 TFD 前的在经过一次非线性变换

- $\tilde{\boldsymbol{\phi}}(t, n)=\operatorname{LayerNorm}\left(\tilde{\boldsymbol{\xi}}{t+n}+\operatorname{GLU}{\tilde{\phi}}(\boldsymbol{\phi}(t, n))\right)$

((64301e1d-88db-4617-a97a-92ebeafd54f6)) 用静态变量增强时序特征 #card

#card

- 静态协变量通常对时间动态有重要影响 ((643020c2-892c-499d-8e24-e40605f0b867))

- $\boldsymbol{\theta}(t, n)=\operatorname{GRN}_\theta\left(\tilde{\boldsymbol{\phi}}(t, n), \boldsymbol{c}_e\right)$

- ((6430212c-e967-4477-8c1a-f92bf17ba06c))

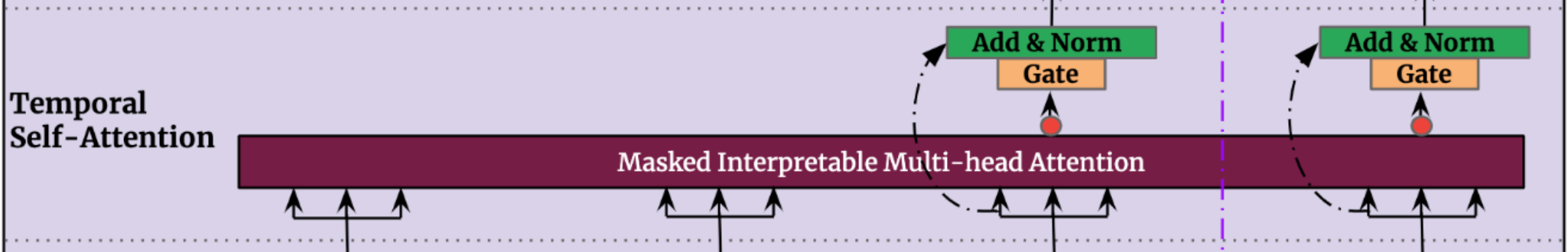

自关注模块 ((64301e11-52ec-4e84-b5af-4f6fde452384)) 学习时序数据的长期依赖关系并提供模型可解释性 #card

#card

- [[Interpretable Multi-Head Attention]],每个 head 使用相同的 QW,然后用多头 attention score 加权平均后的 V 做解释

- $\boldsymbol{B}(t)=$ InterpretableMultiHead $(\boldsymbol{\Theta}(t), \boldsymbol{\Theta}(t), \boldsymbol{\Theta}(t))$

- $\boldsymbol{\delta}(t, n)=\operatorname{LayerNorm}\left(\boldsymbol{\theta}(t, n)+\operatorname{GLU}_\delta(\boldsymbol{\beta}(t, n))\right)$.

((64301e07-2b18-4b81-a4a7-eebc9acebaf6)) 对自关注层的输出应用额外的非线性处理公式 #card

- $\boldsymbol{\psi}(t, n)=\operatorname{GRN}_\psi(\boldsymbol{\delta}(t, n))$

- $\tilde{\boldsymbol{\psi}}(t, n)=\operatorname{LayerNorm}\left(\tilde{\boldsymbol{\phi}}(t, n)+\operatorname{GLU}_{\tilde{\psi}}(\boldsymbol{\psi}(t, n))\right)$

Temporal Fusion Decoder