CVR 去偏

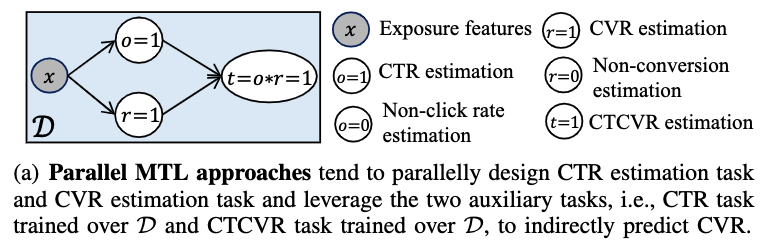

并行多任务模型 [[ESMM]] [[ESM2]]

+ 核心思想 → 并行多任务模型(例如ESMM)通过CTR任务以及一个辅助任务CTCVR来间接计算CVR。

+ 优点:这样做的好处是CTR和CTCVR任务都可以在 {{c1 全曝光}} 样本上训练,而模型在线预测的时候,也在 {{c1 全曝光}} 样本空间进行预测排序。

+ 如何求点击后转化率 #card

+ 并行多任务模型是通过 $p(t=1 \mid x)=p(o=1, r=1 \mid x)=p(o=1 \mid x) * p(r=1 \mid x, o=1)$ ,在全曝光空间,先求出点击率 $p(o=1 \mid x)$ 和点击转化率 $p(t=1 \mid x)$ ,再间接求出点击后转化率 $p(r=1 \mid x, o=1)$ 。

+ 这样就消除了训练空间与推断空间之间 {{c1 不匹配}} 的问题,因而可以缓解点击空间训练数据稀疏,选择偏差的问题。

+ 缺点:并行结构,忽略了点击到转化之间的依赖关系,也就是 {{c1 PIP(potential independence priority)}} 问题。

+ 现有的并行多任务模型结构实际上对应的是另一个概率公式,即 → $p(t=1 \mid x)=p(o=1 \mid x) * p(r=1 \mid x)$ 。

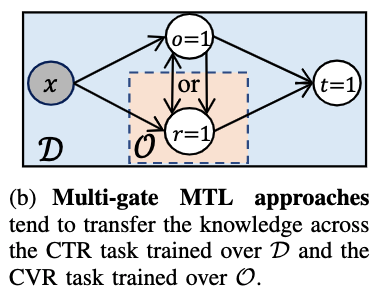

多门的多任务学习模型 (例如:Cross Stitch、MMOE、PLE、MOSE、AITM)

+ 核心思想 #card

+ 多门(Multi-Gate)多任务学习模型考虑了不同任务之间的相关性和差异性,

+ 用Gate的方式来控制不同专家的组合方式。

+ 优点 → 在曝光空间预测CTR, 在点击空间预测CVR。

+ 缺点 → 这些模型没有解决数据Missing not at radom(MNAR)的问题。

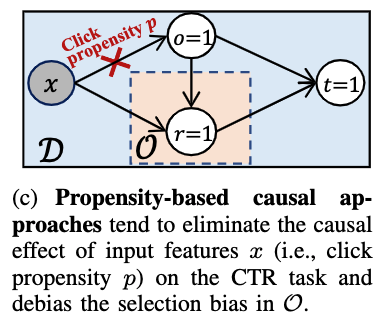

基于倾向性的因果纠偏模型

- [[@LARGE-SCALE CAUSAL APPROACHES TO DEBIASING POST-CLICK CONVERSION RATE ESTIMATION WITH MULTI-TASK LEARNING]] 因果推断相关第一篇

- 这篇文章聚焦于由 {{c1 非随机缺失(MNAR)}} 带来的样本选择偏差(SSB)。具体产生问题的原因 #card

- 现有方法将曝光空间->点击空间中丢弃的样本视为随机丢失。

- 一般点击、转化率比较高的样本才能进入点击空间,因此只考虑点击空间会导致CVR预估值比曝光空间的CVR预估值高。

- 这篇文章从因果角度进行 CVR 估计(去偏),并解释了非随机缺失的原因。

- 这篇文章聚焦于由 {{c1 非随机缺失(MNAR)}} 带来的样本选择偏差(SSB)。具体产生问题的原因 #card

- [[ESCM2]]

- [[用IPS实现CVR建模]]

- {{c1 点击倾向性(点击率)偏高}} 的样本更容易进入到点击空间。

- 因此为了消除 {{c1 点击事件上点击倾向性(click propensity)对后面转化事件}} 的影响,从而得到一个条件无偏的转化率估计 $p(r=1 \mid d o(o=1), x)$ ,IPW(inverse propensity weighting)的策略被广泛应用来纠偏选择偏差,解决MNAR问题。

- [[propensity score 一定能给 cvr 去偏吗?]]

- [[用DR实现CVR建模]] #card

- IPW在点击空间无偏的前提是点击率要预测准确,然而在现实应用场景很难确保这一点,因此提出了DR模型来缓解这个问题。

- 核心思想:除了IPW多任务模型的点击任务,转化任务,DR模型还利用了一个归咎(imputation)任务来预测转化任务的误差,即CVR loss $\left(e_{i, j}=e\left(r_{i, j}, \hat{r}{i, j}\right)\right)$ 的预测值( $\hat{e}{i, j}$ )。而最终DR模型对应的CVR loss function变成了

- $$

\mathcal{E}^{\mathrm{MTL}-\mathrm{DR}}=\frac{1}{|\mathcal{D}|} \sum_{(i, j) \in \mathcal{D}}\left(\hat{e}{i, j}+\frac{o{i, j} \delta_{i, j}}{\hat{o}{i, j}}\right) \text {, 其中 } \delta{i, j}=e_{i, j}-\hat{e}_{i, j} \text { 。 }

$$

- [[用IPS实现CVR建模]]

- [[@DCMT: A Direct Entire-Space Causal Multi-Task Framework for Post-Click Conversion Estimation]]

- Res-IPS/DR:Removing Hidden Confounding in Recommendation: A Unified Multi-Task Learning Approach 北大 NIPS2023

这是一篇纯学术界文章,将因果推断领域的一些结论应用到推荐系统中。(学术界的文章是真晦涩难懂,车轱辘话反复说。不得不佩服,就一个残差和无偏数据,也能吹出一篇文章来) - [[@Utilizing Non-click Samples via Semi-supervised Learning for Conversion Rate Prediction]] 以半监督的方式解cvr未点击样本上学习有偏的问题

[[Ref]]

- [[@汇总|6篇文章带你了解CVR去偏现状]]