RoPE

设计目标:通过绝对位置编码的方式实现相对位置编码 #card

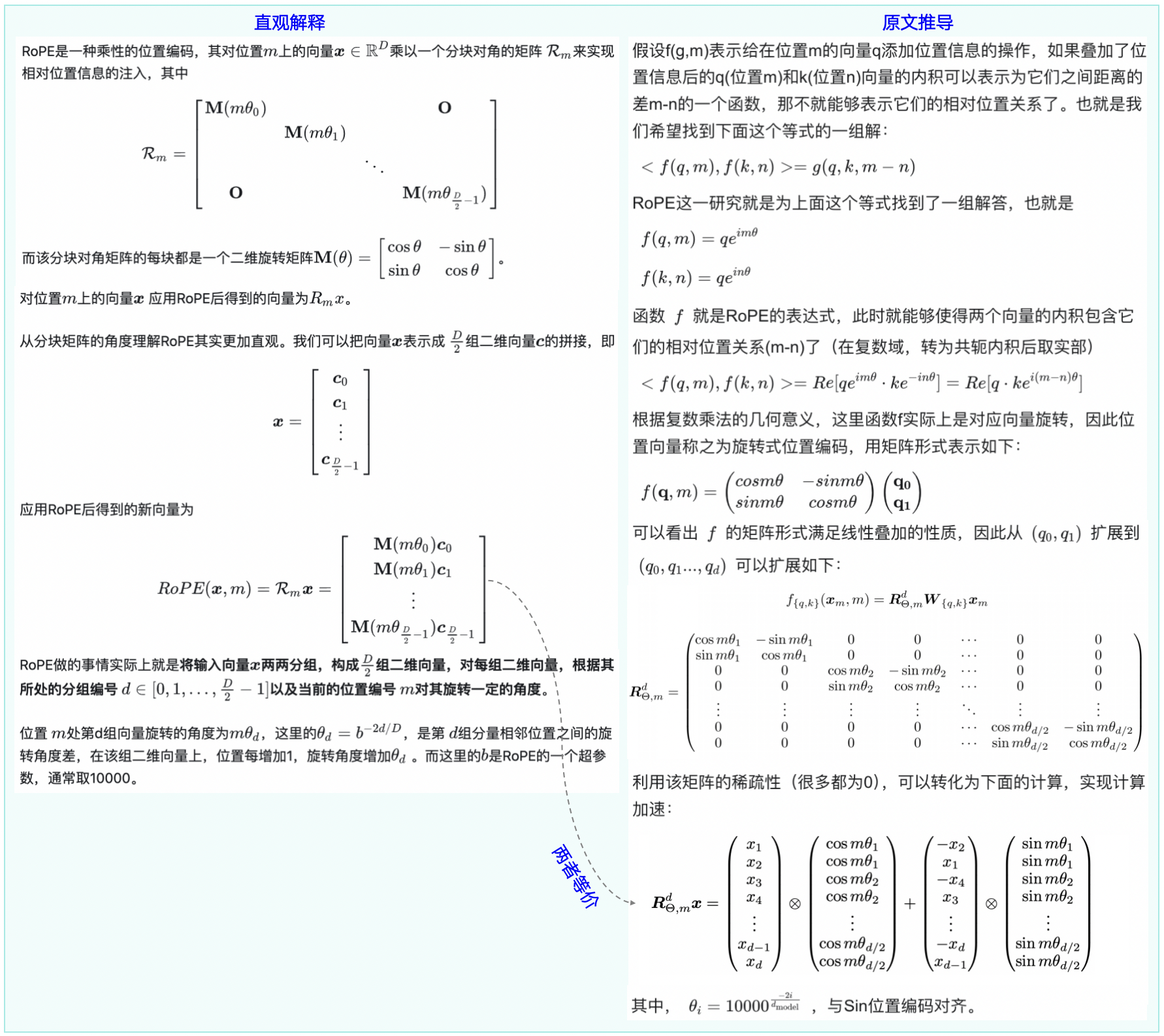

设计思路:在NLP中,通常会通过向量q和k的内积来计算注意力系数(ATTN),如果能够对q、k向量注入位置信息,然后用更新的q、k向量做内积就能丝滑地引入 位置信息 了。

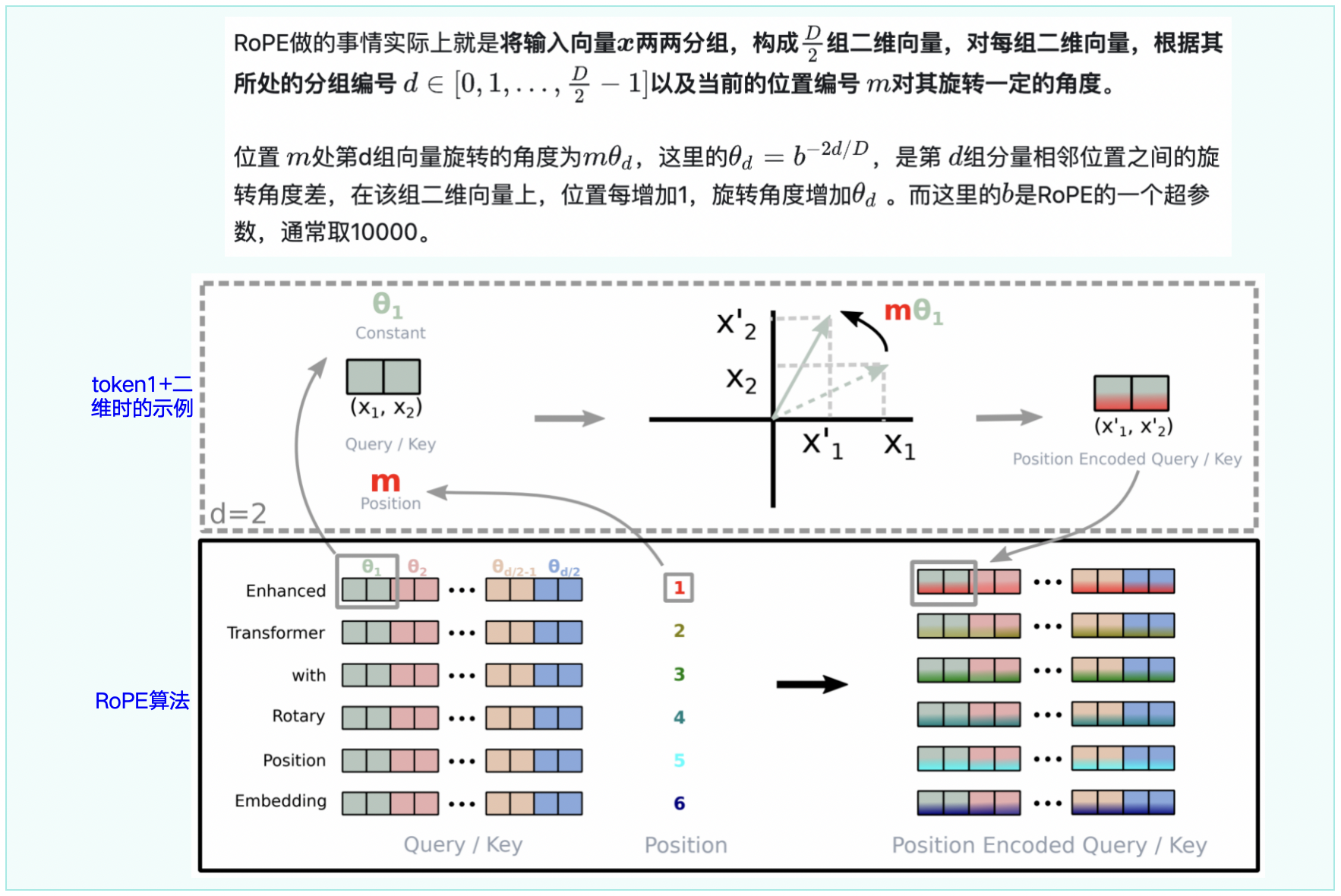

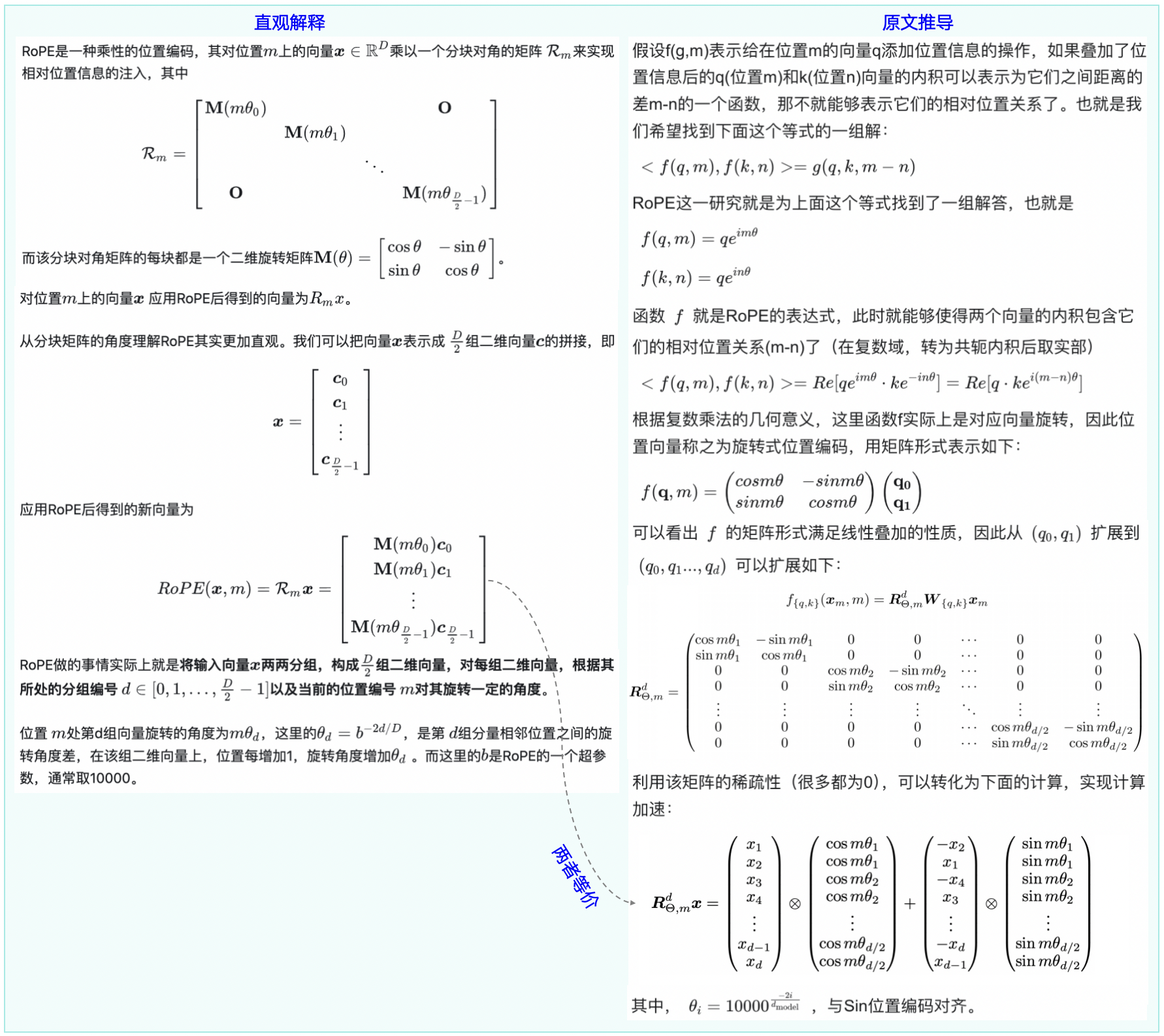

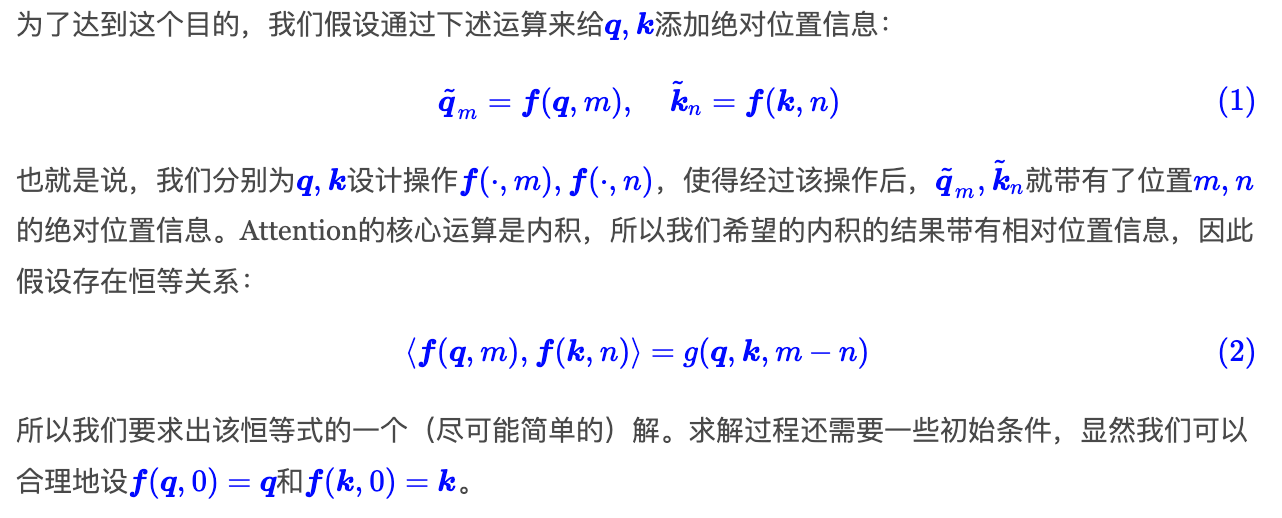

图3-1:RoPE的两种解释(左:直观解释,右:原始推导)#card

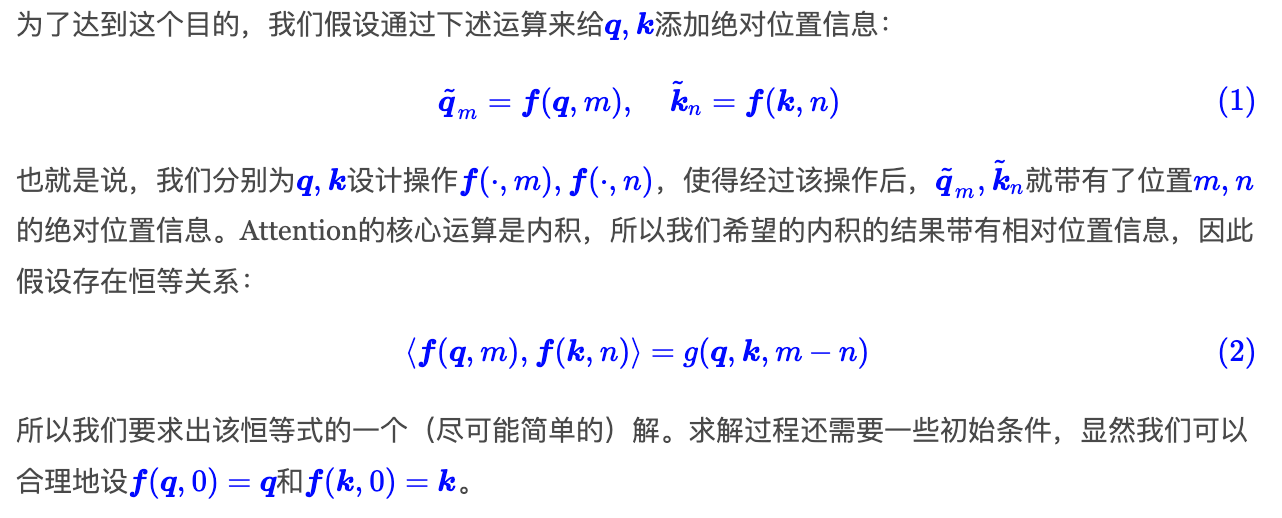

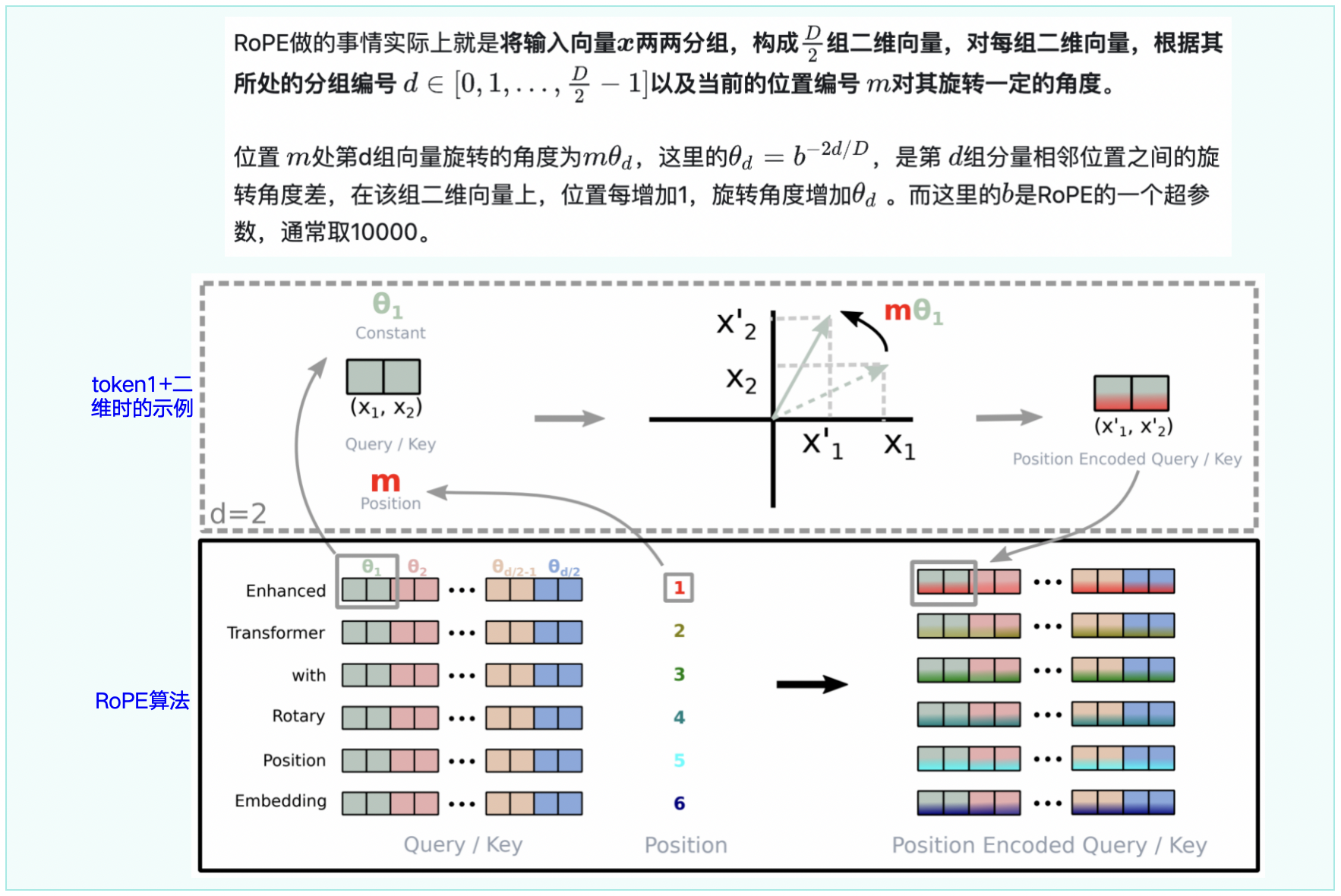

图3-2:RoPE的操作示意图#card

设计目标:通过绝对位置编码的方式实现相对位置编码 #card

设计思路:在NLP中,通常会通过向量q和k的内积来计算注意力系数(ATTN),如果能够对q、k向量注入位置信息,然后用更新的q、k向量做内积就能丝滑地引入 位置信息 了。

图3-1:RoPE的两种解释(左:直观解释,右:原始推导)#card

图3-2:RoPE的操作示意图#card