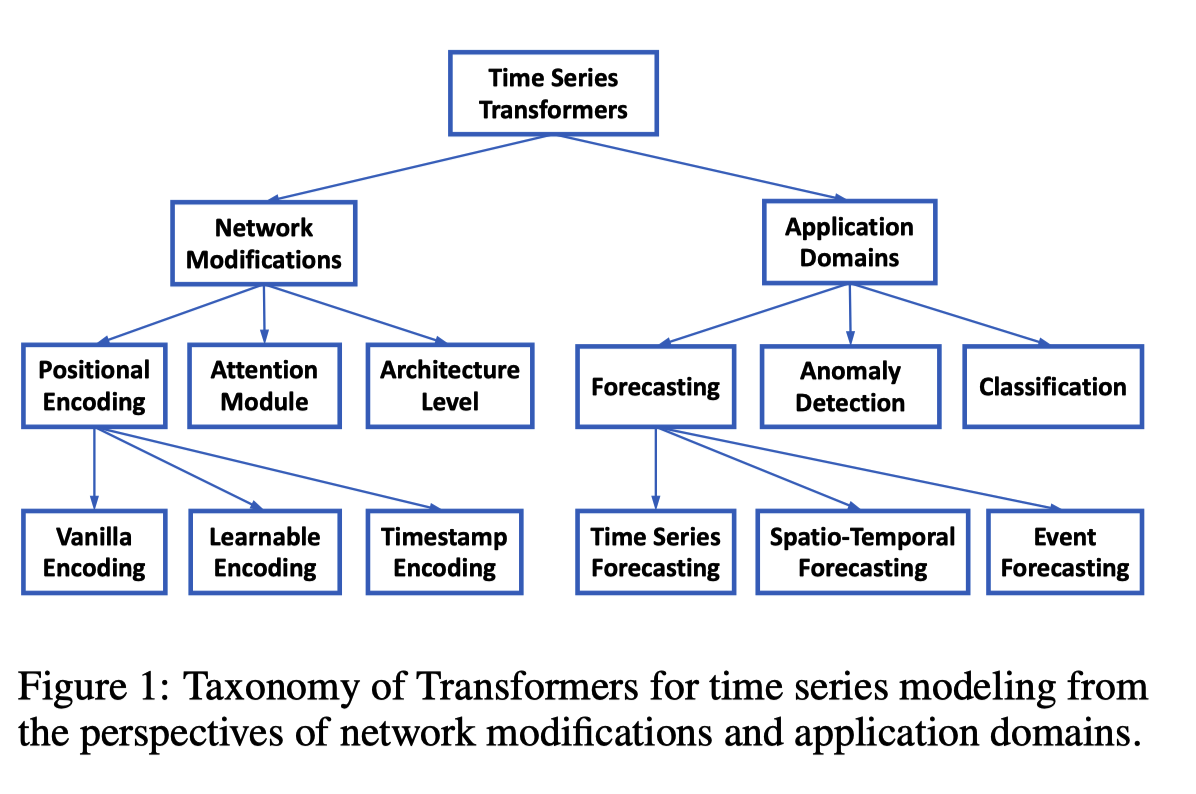

@Transformers in Time Series: A Survey

[[Abstract]]

- Advertising and feed ranking are essential to many Internet companies such as Facebook and Sina Weibo. Among many real-world advertising and feed ranking systems, click through rate (CTR) prediction plays a central role. There are many proposed models in this field such as logistic regression, tree based models, factorization machine based models and deep learning based CTR models. However, many current works calculate the feature interactions in a simple way such as Hadamard product and inner product and they care less about the importance of features. In this paper, a new model named FiBiNET as an abbreviation for Feature Importance and Bilinear feature Interaction NETwork is proposed to dynamically learn the feature importance and fine-grained feature interactions. On the one hand, the FiBiNET can dynamically learn the importance of features via the Squeeze-Excitation network (SENET) mechanism; on the other hand, it is able to effectively learn the feature interactions via bilinear function. We conduct extensive experiments on two realworld datasets and show that our shallow model outperforms other shallow models such as factorization machine(FM) and field-aware factorization machine(FFM). In order to improve performance further, we combine a classical deep neural network(DNN) component with the shallow model to be a deep model. The deep FiBiNET consistently outperforms the other state-of-the-art deep models such as DeepFM and extreme deep factorization machine(XdeepFM).

[[Attachments]]

- FiBiNET_2019_Huang.pdf {{zotero-linked-file “attachments:FiBiNET_2019_Huang.pdf”}}

创新点 #card

- 使用 SENET 层对 embedding 进行加权

- 使用 Bilinear-Interaction Layer 进行特征交叉

背景

- importance of features and feature interactions

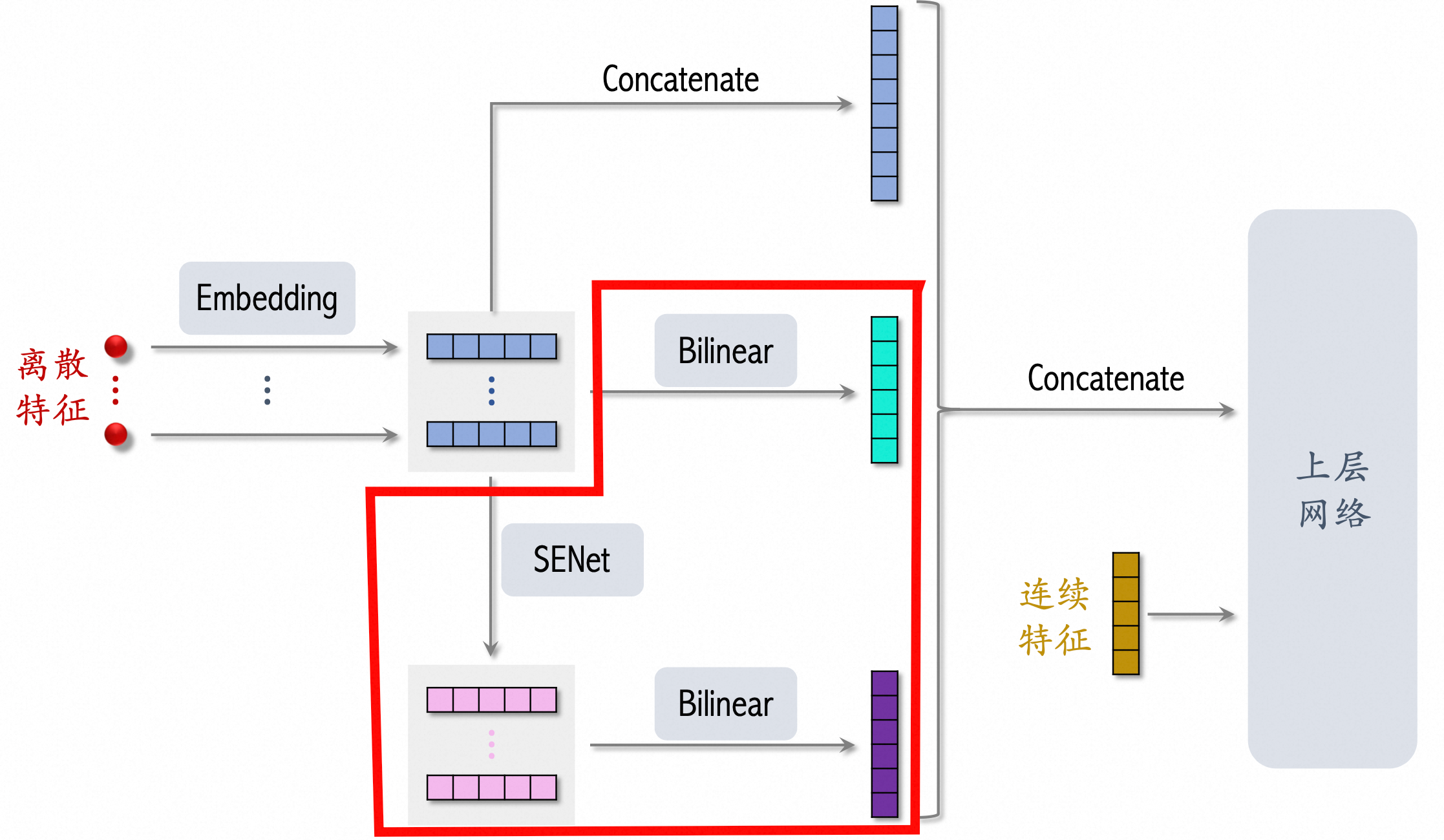

网络结构 #card

[[SENET]] Squeeze-and-Excitation network 特征加权方法

- Squeeze

f*k压缩成f*1 - Excitation 然后通过两层 dnn 变成得到权重

f*1 - Re-Weight 将结果和原始

f*k相乘。 - 原理是想通过控制scale的大小,把重要的特征增强,不重要的特征减弱,从而让提取的特征指向性更强。

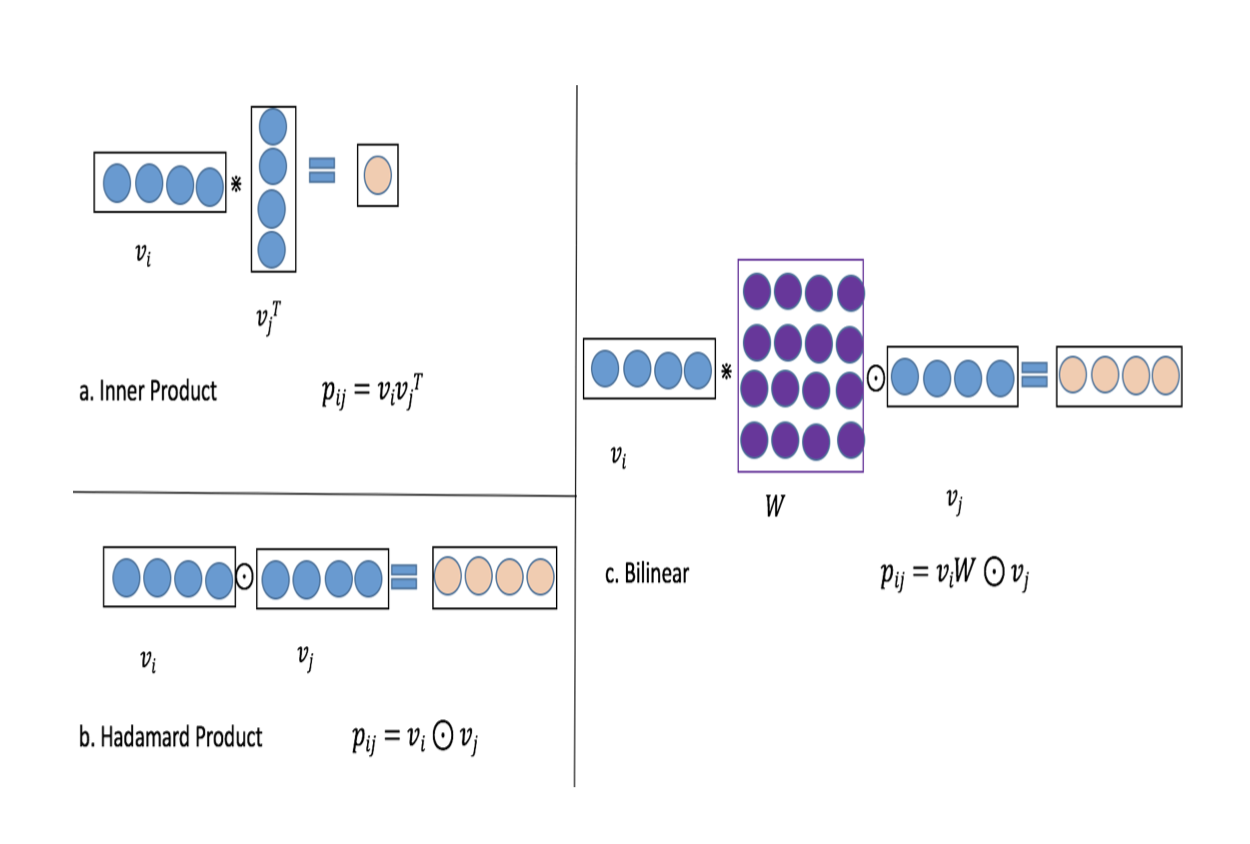

[[Bilinear-Interaction Layer]] → 结合Inner Product和Hadamard Product方式,并引入额外参数矩阵W,学习特征交叉。

- 不同特征之间交叉

v_i * W * v_j时,权重矩阵来源- Field-All Type → 全体共享 W

- 参数量 →

feature * embedding + emb*emb

- 参数量 →

- Field-Each Type → 每个 filed 一组 W

- 参数量 →

feature * embedding + feature*emb*emb

- 参数量 →

- Filed-Interaction Type → 不同特征之间有一组 w

- 参数量 →

feature * embedding + feature*feature*emb*emb

- 参数量 →

- Field-All Type → 全体共享 W

- Bilinear-Interaction Layer 对比 [[FFM]] 有效减少参数量

- FM 参数量 →

feature * embedding - FFM 参数量 →

feature * filed * embedding

- FM 参数量 →

- 不同特征交叉方式

[[ETA]] fm 交叉部分可以尝试引入 bi layer,使用 link 状态组合 W。

- 但是路况状态可能会改变

Ref

@Applying Deep Learning To Airbnb Search

[[Abstract]]

- The application to search ranking is one of the biggest machine learning success stories at Airbnb. Much of the initial gains were driven by a gradient boosted decision tree model. The gains, however, plateaued over time. This paper discusses the work done in applying neural networks in an attempt to break out of that plateau. We present our perspective not with the intention of pushing the frontier of new modeling techniques. Instead, ours is a story of the elements we found useful in applying neural networks to a real life product. Deep learning was steep learning for us. To other teams embarking on similar journeys, we hope an account of our struggles and triumphs will provide some useful pointers. Bon voyage!

[[Attachments]]

- Applying Deep Learning To Airbnb Search_2018_Haldar.pdf {{zotero-linked-file “attachments:Applying Deep Learning To Airbnb Search_2018_Haldar2.pdf”}}

记录 Airbnb 深度模型探索历程。

业务:顾客查询后返回一个有序的列表(Listing,对应房间)。

深度模型之前使用 GBDT 对房子进行打分。

Model Evolution

- 评价指标 [[NDCG]]

- Simple NN

- 32 层 NN + Relu,特征和优化目标和 GBDT 效果相同

- 打通深度模型训练和线上预测的 pipeline。

- LambdaRank NN

- [[LambdaRank]] 直接优化 NDCG

- 采用 pairwise 的训练方式,构造 <被预定的房间,未被预定的房间> 的训练样本

- pairwise loss 乘上 item 对调顺序带来的指标变化 NDCG,关注列表中靠前位置的样本

- 比如 booked listing 从 2 到 1 的价值比 books listing 从 10 到 9 的意义大。

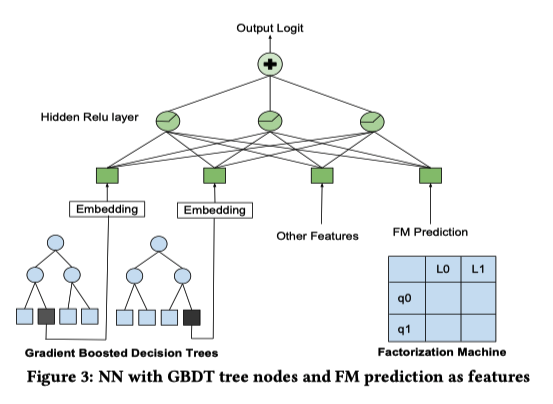

- Decision Tree/Factorization Machine NN

- GBDT 叶子节点位置(类别特征) + FM 预测结果放到 NN 中。

- Deep NN

- 10 倍训练数据,195 个特征(离散特征 embedding 化),两层神经网络:127 fc + relu 以及 83 fc + relu。

- 部分 dnn 的特征是来自其他模型,之间在 [[@Real-time Personalization using Embeddings for Search Ranking at Airbnb]] 里面提到的特征也有使用。

- 在训练样本达到 17 亿后,ndcg 在测试集和训练集的表现一致,这样一来可以使用线下的效果来评估线上的效果?

- 深度模型在图像分类任务上已经超过人类的表现,但是很难判断是否在搜索任务上也超过人类。一个关键是很难定义搜索任务中的人类能力。

Failed Models

- Listing ID

- listing id 进行 embedding,但是出现过拟合。

- embedding 需要每个物品拥有大量数据进行训练,来挖掘他们的价值

- 部分 Listing 有一些独特的属性,需要一定量的数据进行训练。

- listing id 进行 embedding,但是出现过拟合。

- Multi-task learning

- booking 比 view 更加稀疏,long view 和 booking 是有相关的。

- 两个任务 Booking Logit 和 Long View Logit,共享网络结构。两个指标在数量级上有差异,为了更加关注 booking 的指标,long view label 乘上 log(view_duration)。

- 线上实验中,页面浏览的时间提高,但是 booking 指标基本不变。

- 作者分析长时间浏览一个页面可能是高档房源或页面描述比较长。

- [[Feature Engineering]]

- GBDT 常用的特征工程方法:计算比值,滑动窗口平均以及特征组合。

- NN 可以通过隐层自动进行特征交叉,对特征进行一定程度上的处理可以让 NN 更加有效。

- Feature [[Normalization]]

- NN 对数值特征敏感,如果输入的特征过大,反向传播时梯度会很大。

- 正态分布

- $$(feature_val - \mu)/\rho$$

- power law distribution

- $$\log \frac{1+feature_val}{1+median}$$

- Feature distribution

- 特征分布平滑

- 是否存在异常值?

- 更容易泛化,保证高层输出有良好的分布

- [[Hyperparameters]]

- [[Dropout]] 看成是一种数据增强的方法,模拟了数据中会出现随机缺失值的情况。drop 之后可能会导致样本不再成立,分散模型注意力的无效场景。

- 替代方案,根据特征分布人工产生噪音加入训练样本,线下有效果,线上没有效果。

- [[神经网络参数全部初始化为0]] 没有效果,[[Xavier Initialization]] 初始化参数,Embedding 使用 -1 到 1 的随机分布。

- Learning rate 默认参数 [[Adam]] 效果不太好,使用 [[LazyAdam]] 在较大 embedding 场景下训练速度更快

- [[Dropout]] 看成是一种数据增强的方法,模拟了数据中会出现随机缺失值的情况。drop 之后可能会导致样本不再成立,分散模型注意力的无效场景。

- Feature Importance [[可解释性]]

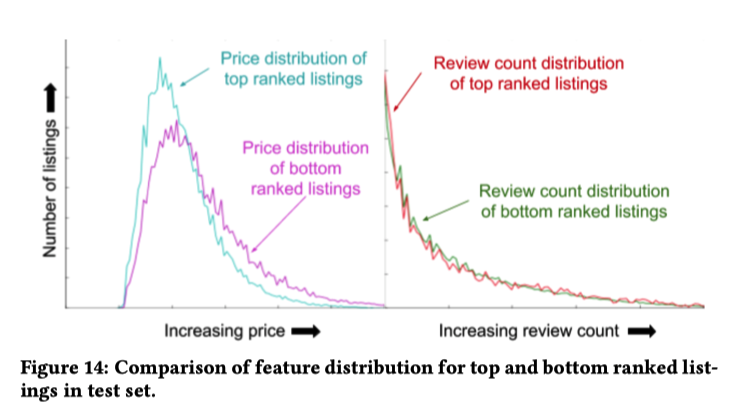

Score Decomposition将 NN 的分数分解到特征上。[[GBDT]] 可以这样做。Ablation Test每次训练一个模型删除一个特征。问题是模型可以从剩余的特征中弥补出缺失的特征。Permutation Test选定一个特征,随机生成值。[[Random Forests]] 中常用的方法。新生成的样本可能和现实世界中的分布不同。一个特征可能和其他特征共同作用产生效果。TopBot Analysis分析排序结果 top 和 bot 的单独特征分布- 左边代表房子价格的分布,top 和 bot 的分布存在明显不同,代表模型对价格敏感。

- 右边代表页面浏览量的分布,top 和 bot 的分布接近,说明模型没有很好利用这个特征。

{:height 415, :width 716}

{:height 415, :width 716}

奇怪的东西

- 论文中一直在引用 [[Andrej Karpathy]] 的建议:don’t be a hero

@Learning Piece-wise Linear Models from Large Scale Data for Ad Click Prediction

[[Abstract]]

- CTR prediction in real-world business is a difficult machine learning problem with large scale nonlinear sparse data. In this paper, we introduce an industrial strength solution with model named Large Scale Piece-wise Linear Model (LS-PLM). We formulate the learning problem with L1 and L2,1 regularizers, leading to a non-convex and non-smooth optimization problem. Then, we propose a novel algorithm to solve it efficiently, based on directional derivatives and quasi-Newton method. In addition, we design a distributed system which can run on hundreds of machines parallel and provides us with the industrial scalability. LS-PLM model can capture nonlinear patterns from massive sparse data, saving us from heavy feature engineering jobs. Since 2012, LS-PLM has become the main CTR prediction model in Alibaba’s online display advertising system, serving hundreds of millions users every day.

[[Attachments]]

- Learning Piece-wise Linear Models from Large Scale Data for Ad Click Prediction_2017_Gai.pdf {{zotero-linked-file “attachments:Learning Piece-wise Linear Models from Large Scale Data for Ad Click Prediction_2017_Gai.pdf”}}

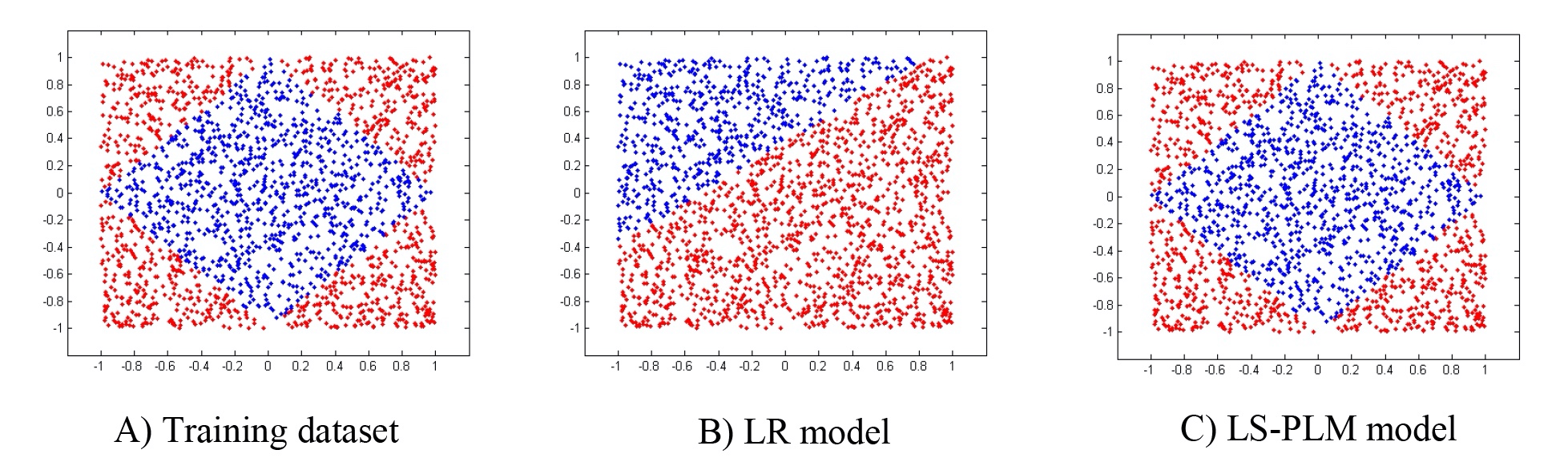

分片线性方式对数据进行拟合,将空间分成多个区域,每个区域使用线性的方式进行拟合,最后的输出变为多个子区域预测值的加权平均。

相当于对多个区域做一个 [[Attention]]

结构与三层神经网络类似

Model

处理大规模稀疏非线性特征

LS-PLM 模型学习数据的非线性特征。

question 为什么 LR 模型不能区分下面的数据,如何区分数据?[[SVM]][[FM]]

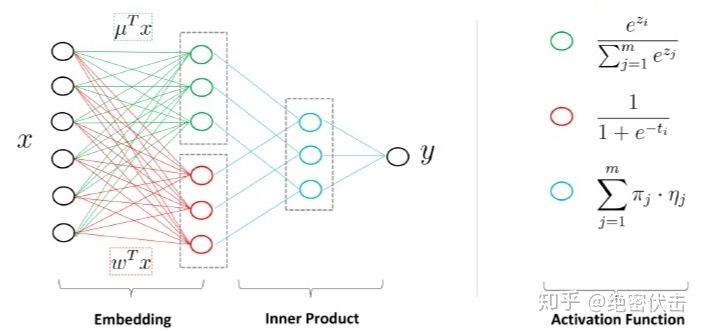

$$p(y=1 | x)=g\left(\sum_{j=1}^{m} \sigma\left(u_{j}^{T} x\right) \eta\left(w_{j}^{T} x\right)\right)$$

u 和 w 都是 d 维向量

m 为划分 region 数量

一般化使用:

$$p(y=1 | x)=\sum_{i=1}^{m} \frac{\exp \left(u_{i}^{T} x\right)}{\sum_{j=1}^{m} \exp \left(u_{j}^{T} x\right)} \cdot \frac{1}{1+\exp \left(-w_{i}^{T} x\right)}$$

可以把上面的模型看成是三层神经网络

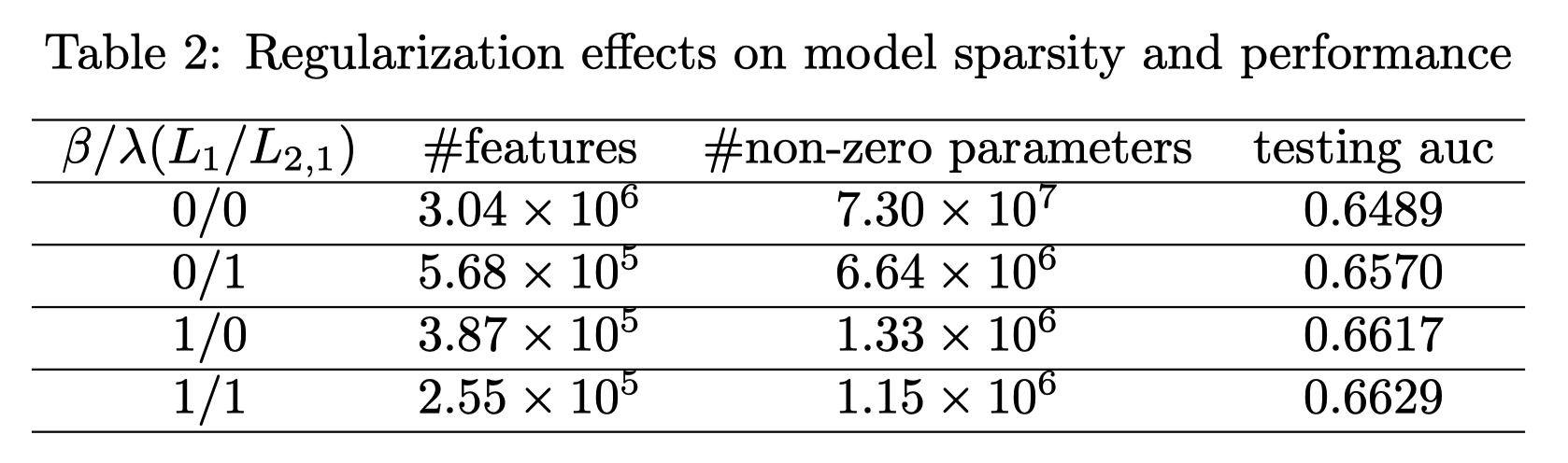

Regularization

- $$\arg \min {\Theta} f(\Theta)=\operatorname{loss}(\Theta)+\lambda|\Theta|{2,1}+\beta|\Theta|_{1}$$

- L1 和常规一样,保持参数的稀疏性。

- L2 如下面的公式,对每一个 feature 的参数进行二阶正则,然后累加。最优化的过程中,L2 项越来越小,相当于做特征选择。每一个特征不止一个参数,只有某一个特征的全部参数都为 0 ,代表这个特征是没有用的。

- $$|\Theta|{2,1}=\sum{i=1}^{d} \sqrt{\sum_{j=1}^{2 m} \theta_{i j}^{2}}$$

- 正则后的效果:

@wait 后面如何求解这损失函数以及工程实现待看。

[[Ref]]